Mare Liberum

Anatomia di un Sistema di IA

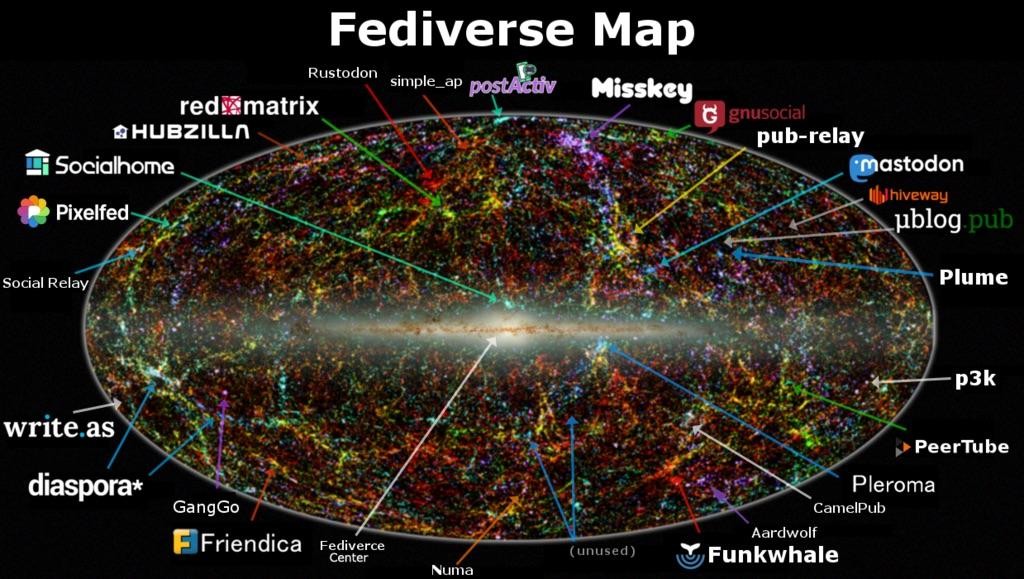

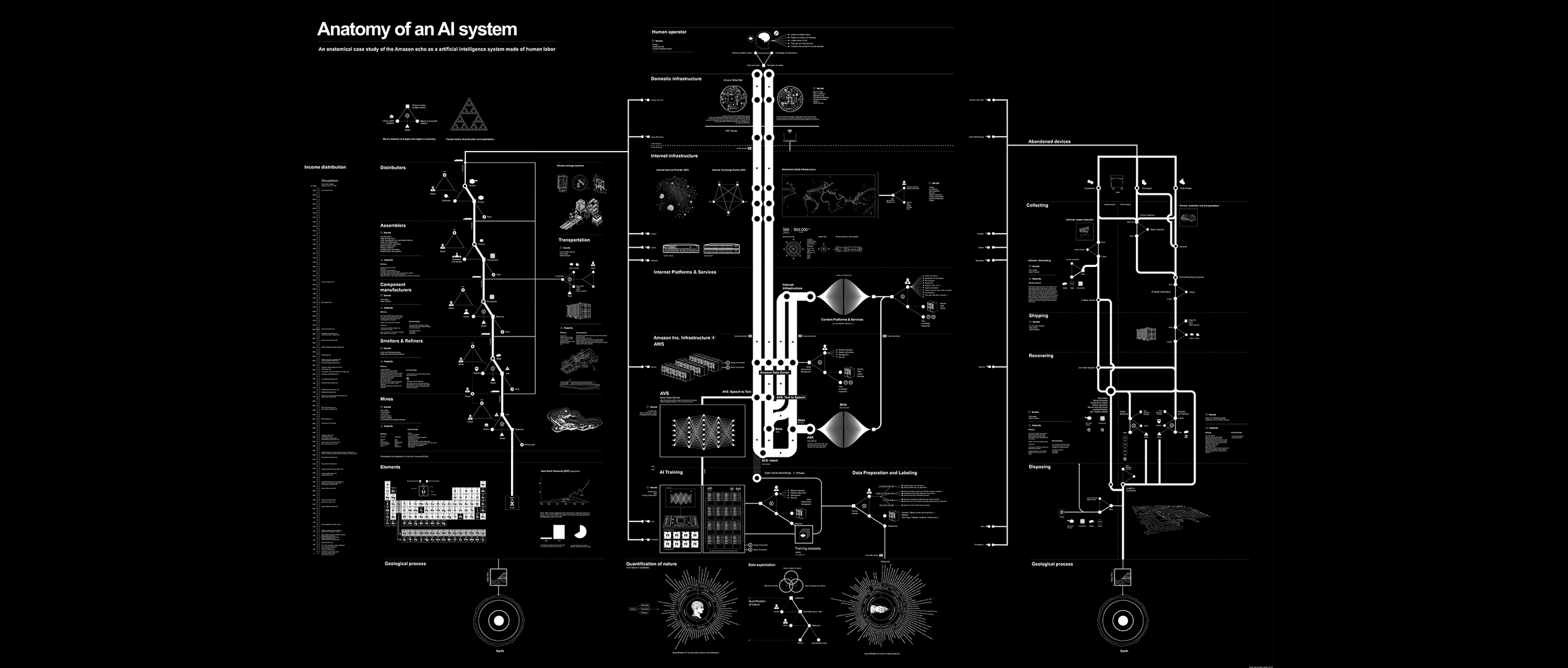

Per vedere la mappa in scala reale o scaricarla in formato pdf, vai qui: map

Per vedere la mappa in scala reale o scaricarla in formato pdf, vai qui: map

Anatomia di

un Sistema di IA

Amazon Echo come mappa anatomica del lavoro umano, dei dati e delle risorse del pianeta

Di Kate Crawford [^ 1] and Vladan Joler[ ]^ 2] (2018)

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

I

Un cilindro si trova in una stanza. È impassibile, liscio, semplice e piccolo. È alto 14,8 cm, con un’unica luce circolare blu-verde che si sviluppa intorno al bordo superiore. Assiste in silenzio. Una donna entra nella stanza, con un bambino addormentato in braccio, e si rivolge al cilindro.

Alexa, accendi le luci della sala”.

Il cilindro prende vita. OK. La stanza si illumina. La donna fa un lieve cenno di assenso e porta il bambino al piano di sopra.

Questa è un’interazione con il dispositivo Echo di Amazon. 3 Un breve comando e una risposta sono la forma più comune di coinvolgimento con questo dispositivo di intelligenza artificiale abilitato per i consumatori. Ma in questo fugace momento di interazione, viene invocata una vasta matrice di capacità: catene intrecciate di estrazione di risorse, lavoro umano ed elaborazione algoritmica attraverso reti di estrazione, logistica, distribuzione, previsione e ottimizzazione. La scala di questo sistema è quasi al di là dell’immaginazione umana. Come possiamo iniziare a vederlo, a coglierne l’immensità e la complessità come forma connessa? Iniziamo con uno schema: una vista esplosa di un sistema planetario attraverso tre fasi di nascita, vita e morte, accompagnata da un saggio in 21 parti. L’insieme diventa una mappa anatomica di un singolo sistema di intelligenza artificiale.

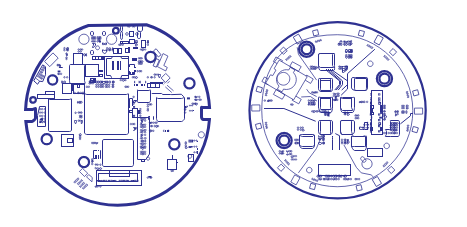

Amazon Echo Dot (schemi)

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬I

II

La scena della donna che parla con Alexa è tratta da un video promozionale del 2017 che pubblicizza l’ultima versione di Amazon Echo. Il video inizia con “Saluta il nuovissimo Echo” e spiega che l’Echo si connetterà ad Alexa (l’agente intelligente o agente razionale) per “riprodurre musica, chiamare amici e famigliari, controllare dispositivi domestici intelligenti (smart) e molto altro”. Il dispositivo contiene sette microfoni direzionali, in modo che l’utente possa essere ascoltato in ogni momento anche durante la riproduzione di musica. Il dispositivo è disponibile in diversi stili, come il grigio scuro metallizzato o il beige di base, progettati per “mimetizzarsi o distinguersi”. Ma anche le opzioni di design più brillanti mantengono una sorta di bianco: nulla avverte il proprietario della vasta rete che sottende e guida le sue capacità interattive. Il video promozionale afferma semplicemente che la gamma di cose che si possono chiedere ad Alexa è in continua espansione. “Poiché Alexa è nel cloud, diventa sempre più intelligente e aggiunge nuove funzioni”.

Come avviene questo? Alexa è una voce disincarnata che rappresenta l’interfaccia di interazione essere umano-IA per una serie straordinariamente complessa di livelli di elaborazione delle informazioni. Questi livelli sono alimentati da maree costanti: il flusso di voci umane che vengono tradotte in domande testuali, utilizzate per interrogare database di potenziali risposte, e il corrispondente flusso di risposte di Alexa. Per ogni risposta fornita da Alexa, la sua efficacia viene dedotta da ciò che accade successivamente:

Viene riproposta la stessa domanda? (L’utente si è sentito ascoltato?)

La domanda è stata riformulata? (L’utente ha avuto la sensazione che la domanda fosse stata compresa?).

C’è stata un’azione dopo la domanda? (L’interazione ha portato a una risposta tracciata: una luce accesa, un prodotto acquistato, un brano riprodotto).

Con ogni interazione, Alexa si allena a sentire meglio, a interpretare in modo più preciso, a innescare azioni che corrispondono più accuratamente ai comandi dell’utente e a costruire un modello più completo delle sue preferenze, abitudini e desideri. Cosa è necessario per rendere tutto ciò possibile? In parole povere: ogni piccola comodità – che si tratti di rispondere a una domanda, accendere una luce o suonare una canzone – richiede una vasta rete planetaria, alimentata dall’estrazione di materie non-rinnovabili, manodopera e dati. L’entità delle risorse richieste è di gran lunga superiore all’energia e alla manodopera necessarie a un essere umano per far funzionare un elettrodomestico o premere un interruttore. Una contabilità completa di questi costi è quasi impossibile, ma è sempre più importante coglierne l’entità e la portata se vogliamo comprendere e governare le infrastrutture tecniche che attraversano le nostre vite.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

III

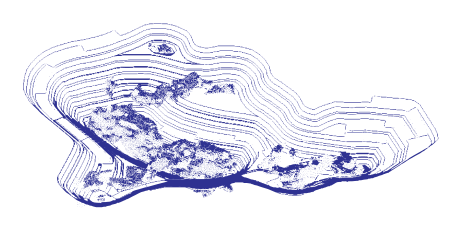

Il Salar, la più grande superficie pianeggiante del mondo, si trova nel sud-ovest della Bolivia, a un’altitudine di 3.656 metri sul livello del mare. Si tratta di un altopiano ricoperto da pochi metri di crosta salina eccezionalmente ricca di litio, che contiene il 50%-70% delle riserve mondiali di litio. 4 Il Salar, insieme alle vicine regioni di Atacama in Cile e Argentina, sono i principali siti di estrazione del litio. Questo metallo morbido e argenteo viene attualmente utilizzato per alimentare i dispositivi mobili connessi, come materiale fondamentale per la produzione di batterie agli ioni di litio. È noto come “oro grigio”. Le batterie degli smartphone, ad esempio, contengono solitamente meno di otto grammi di questo materiale. 5 Ogni auto Tesla ha bisogno di circa sette chilogrammi di litio per il suo pacco batterie. 6 Tutte queste batterie hanno una durata limitata e una volta consumate vengono gettate via come rifiuti. Amazon ricorda agli utenti che non è possibile aprire e riparare il proprio Echo, perché questo invalida la garanzia. Amazon Echo è alimentato a parete e dispone anche di una batteria mobile. Anche questa ha una durata limitata e deve essere gettata via come rifiuto.

Secondo le leggende Aymara sulla creazione della Bolivia, le montagne vulcaniche dell’altopiano andino sono state create da una tragedia. 7 Molto tempo fa, quando i vulcani erano vivi e vagavano liberamente per le pianure, Tunupa – l’unico vulcano femmina – diede alla luce un bambino. Colpiti dalla gelosia, i vulcani maschi le rubarono il bambino e lo bandirono in un luogo lontano. Gli dei punirono i vulcani immobilizzandoli tutti sulla Terra. Addolorata per il bambino che non poteva più raggiungere, Tunupa pianse profondamente. Le sue lacrime e il latte materno si unirono per creare un gigantesco lago salato: Salar de Uyuni. Come osservano Liam Young e Kate Davies, “il vostro smartphone funziona con le lacrime e il latte materno di un vulcano”. Questo paesaggio è collegato a qualsiasi luogo del pianeta attraverso i telefoni che abbiamo in tasca; è legato a ciascuno di noi da fili invisibili di commercio, scienza, politica e potere”. 8

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

IV

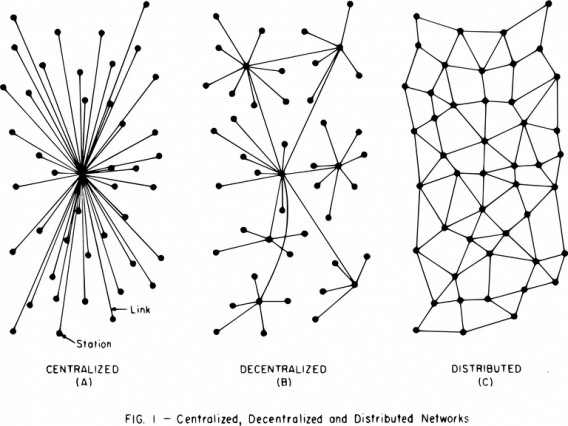

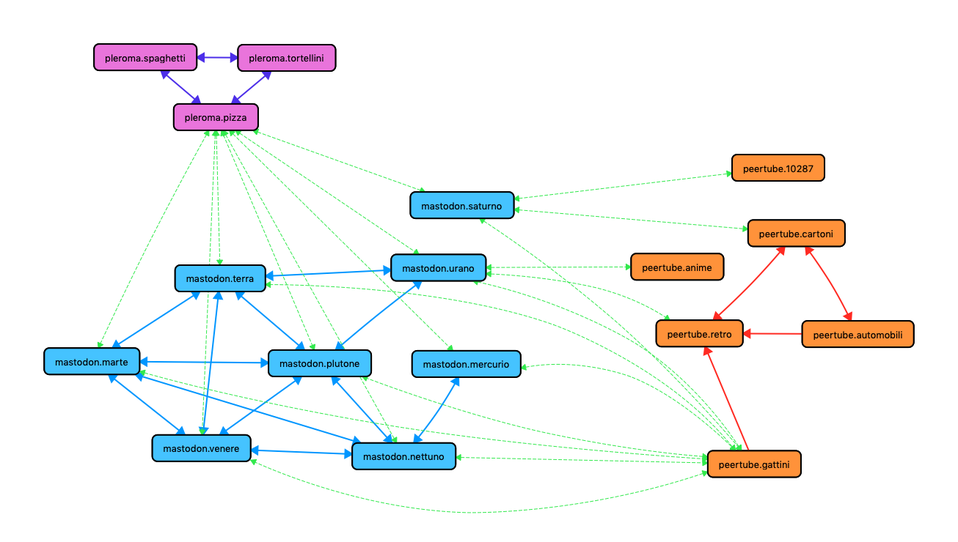

Il nostro diagramma esploso accosta e visualizza tre processi centrali ed estrattivi necessari per far funzionare un sistema di intelligenza artificiale su larga scala: risorse materiali, lavoro umano e dati. Consideriamo questi tre elementi nel tempo, rappresentati come una descrizione visiva della nascita, della vita e della morte di una singola unità Amazon Echo. È necessario andare oltre la semplice analisi del rapporto tra un singolo essere umano, i suoi dati e una singola azienda tecnologica per affrontare la scala veramente planetaria dell’estrazione. Vincent Mosco ha mostrato come la metafora eterea della “nuvola” per la gestione e l’elaborazione dei dati esterni sia in completa contraddizione con la realtà fisica dell’estrazione di minerali dalla crosta terrestre e dell’espropriazione delle popolazioni umane che ne sostengono l’esistenza. 9 Sandro Mezzadra e Brett Nielson usano il termine “estrattivismo” per indicare la relazione tra le diverse forme di operazioni estrattive nel capitalismo contemporaneo, che vediamo ripetersi nel contesto dell’industria dell’IA. 10 Esistono profonde interconnessioni tra il letterale svuotamento dei materiali della terra e della biosfera e la cattura dei dati e la monetizzazione delle pratiche umane di comunicazione e socialità nell’IA. Mezzadra e Nielson notano che il lavoro è al centro di questa relazione estrattiva, che si è ripetuta nel corso della storia: dal modo in cui l’imperialismo europeo ha utilizzato il lavoro degli schiavi, alle squadre di lavoro forzato nelle piantagioni di caucciù in Malesia, alle popolazioni indigene della Bolivia spinte a estrarre l’argento che è stato utilizzato nella prima moneta globale. Pensare all’estrazione richiede di pensare al lavoro, alle risorse e ai dati insieme. Ciò rappresenta una sfida per la comprensione critica e popolare dell’intelligenza artificiale: è difficile “vedere” uno qualsiasi di questi processi singolarmente, per non parlare di quelli collettivi. Da qui la necessità di una visualizzazione in grado di riunire in un’unica mappa questi processi collegati ma dispersi a livello globale.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

V

Se si legge la nostra mappa da sinistra a destra, la storia inizia e finisce con la Terra e i processi geologici del tempo profondo. Ma se la leggiamo dall’alto verso il basso, vediamo la storia che inizia e finisce con un essere umano. In alto c’è l’agente umano che interroga l’Echo e fornisce ad Amazon i preziosi dati di addestramento delle domande e delle risposte verbali che può utilizzare per perfezionare ulteriormente i suoi sistemi di intelligenza artificiale abilitati alla voce. Nella parte inferiore della mappa si trova un altro tipo di risorsa umana: la storia della conoscenza e della capacità umana, che viene utilizzata anche per addestrare e ottimizzare i sistemi di intelligenza artificiale. Questa è una differenza fondamentale tra i sistemi di intelligenza artificiale e altre forme di tecnologia di consumo: si basano sull’ingestione, l’analisi e l’ottimizzazione di grandi quantità di immagini, testi e video generati dall’uomo.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

VI

Quando un essere umano interagisce con un Echo o con un altro dispositivo di intelligenza artificiale abilitato alla riproduzione vocale, agisce come molto più di un semplice consumatore di prodotti finali. È difficile collocare l’utente umano di un sistema di IA in un’unica categoria: merita piuttosto di essere considerato come un caso ibrido. Così come la chimera greca era un animale mitologico in parte leone, in parte capra, in parte serpente e in parte mostro, l’utente di Echo è contemporaneamente un consumatore, una risorsa, un lavoratore e un prodotto. Questa identità multipla ricorre per gli utenti umani in molti sistemi tecnologici. Nel caso specifico di Amazon Echo, l’utente ha acquistato un dispositivo di consumo per il quale riceve una serie di comodi vantaggi. Ma è anche una risorsa, poiché i suoi comandi vocali vengono raccolti, analizzati e conservati per costruire un corpus sempre più ampio di voci e istruzioni umane. Forniscono anche avoro, in quanto svolgono continuamente il prezioso servizio di contribuire ai meccanismi di feedback relativi all’accuratezza, all’utilità e alla qualità complessiva delle risposte di Alexa. In sostanza, contribuiscono ad addestrare le reti neurali all’interno dello stack infrastrutturale di Amazon.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

VII

Tutto ciò che va oltre le limitate interfacce fisiche e digitali del dispositivo stesso è fuori dal controllo dell’utente. Il dispositivo si presenta come una superficie elegante, senza la possibilità di aprirlo, ripararlo o modificarne il funzionamento. L’oggetto in sé è una semplicissima estrusione di plastica che rappresenta un insieme di sensori: la sua vera potenza e complessità si trova altrove, lontano dalla vista. L’Echo non è altro che un “orecchio” in casa: un agente di ascolto disincarnato che non mostra mai le sue profonde connessioni con i sistemi remoti.

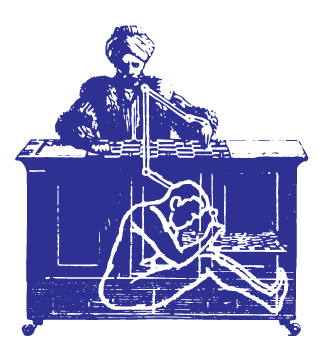

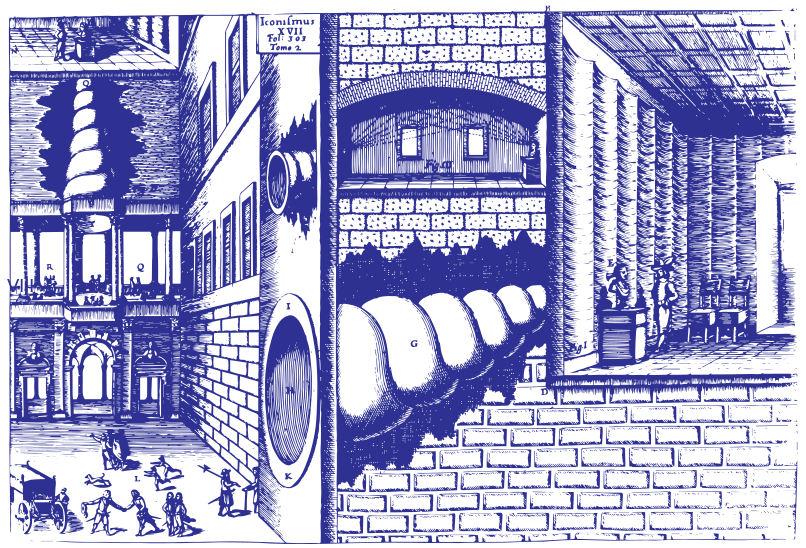

Nel 1673, il polimatico gesuita Athanasius Kircher inventò la statua citofonica, la “statua parlante”. Kircher fu uno straordinario studioso e inventore interdisciplinare. Nella sua vita pubblicò quaranta opere importanti nei campi della medicina, della geologia, della religione comparata e della musica. Inventò il primo orologio magnetico, molti dei primi automi e il megafono. La sua statua parlante era un sistema di ascolto molto precoce: essenzialmente un microfono ricavato da un enorme tubo a spirale, che poteva trasmettere le conversazioni da una piazza pubblica e salire attraverso il tubo, per poi passare attraverso la bocca di una statua conservata nelle stanze private di un aristocratico. Come scrisse Kircher:

“Questa statua deve essere collocata in un determinato luogo, in modo che la sezione finale del tubo a spirale corrisponda esattamente all’apertura della bocca. In questo modo sarà perfetta, e in grado di emettere chiaramente qualsiasi tipo di suono: infatti la statua sarà in grado di parlare continuamente, pronunciando una voce umana o animale: riderà o sogghignerà; sembrerà piangere o gemere davvero; a volte con grande stupore soffierà con forza. Se l’apertura del tubo a forma di spirale si trova in corrispondenza di uno spazio pubblico aperto, tutte le parole umane pronunciate, concentrate nel condotto, verrebbero riprodotte attraverso la bocca della statua”. 11

Il sistema di ascolto poteva origliare le conversazioni quotidiane della piazza e trasmetterle agli oligarchi italiani del XVII secolo. La statua parlante di Kircher era una prima forma di estrazione di informazioni per le élite: le persone che parlavano per strada non avevano alcuna indicazione del fatto che le loro conversazioni venissero incanalate verso coloro che avrebbero sfruttato quella conoscenza per il proprio potere, intrattenimento e ricchezza. Le persone all’interno delle case degli aristocratici non avrebbero avuto idea di come una statua magica parlasse e trasmettesse ogni sorta di informazione. L’obiettivo era quello di oscurare il funzionamento del sistema: una statua elegante era tutto ciò che potevano vedere. I sistemi di ascolto, anche in questa fase iniziale, avevano a che fare con il potere, la classe e la segretezza. Ma l’infrastruttura del sistema di Kircher era proibitiva e disponibile solo per pochi. Rimane quindi la domanda: quali sono le implicazioni in termini di risorse per la costruzione di tali sistemi? Questo ci porta alla materialità dell’infrastruttura sottostante.

Statua citofonica di Athanasius Kircher (1673)

Statua citofonica di Athanasius Kircher (1673)

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

VIII

Nel suo libro A Geology of Media, Jussi Parikka suggerisce di provare a pensare ai media non dal punto di vista di Marshall McLuhan – in cui i media sono estensioni dei sensi umani 12 – ma piuttosto come un’estensione della Terra. 13 Le tecnologie dei media dovrebbero essere comprese nel contesto di un processo geologico, dalla creazione e dai processi di trasformazione, al movimento degli elementi naturali da cui i media sono costruiti. Riflettere sui media e sulla tecnologia come processi geologici ci permette di considerare il profondo esaurimento delle risorse non rinnovabili necessarie per alimentare le tecnologie del momento. Ogni oggetto della rete estesa di un sistema di intelligenza artificiale, dai router di rete alle batterie ai microfoni, è costruito utilizzando elementi che hanno richiesto miliardi di anni per essere prodotti. Guardando dalla prospettiva del tempo profondo, stiamo estraendo la storia della Terra per servire una frazione di secondo di tempo tecnologico, al fine di costruire dispositivi che spesso sono progettati per essere utilizzati per non più di qualche anno. Ad esempio, la Consumer Technology Association rileva che la vita media degli smartphone è di 4,7 anni. 14 Questo ciclo di obsolescenza alimenta l’acquisto di un maggior numero di dispositivi, fa aumentare i profitti e incentiva l’uso di pratiche di estrazione non sostenibili. Da un lento processo di sviluppo degli elementi, questi elementi e materiali attraversano un periodo straordinariamente rapido di scavo, fusione, miscelazione e trasporto logistico – attraversando migliaia di chilometri nella loro trasformazione. I processi geologici segnano sia l’inizio che la fine di questo periodo, dall’estrazione del minerale al deposito del materiale in una discarica elettronica. Per questo motivo, la nostra mappa inizia e finisce con la crosta terrestre. Tuttavia, tutte le trasformazioni e i movimenti che raffiguriamo sono solo un abbozzo anatomico: al di sotto di queste connessioni si trovano molti altri strati di catene di approvvigionamento frattali, sfruttamento delle risorse umane e naturali, concentrazioni di potere aziendale e geopolitico e consumo continuo di energia.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

IX

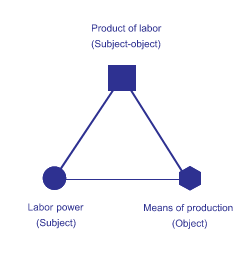

Tracciare le connessioni tra risorse, lavoro ed estrazione di dati ci riporta inevitabilmente ai quadri tradizionali di sfruttamento. Ma come viene generato il valore attraverso questi sistemi? Un utile strumento concettuale si trova nel lavoro di Christian Fuchs e di altri autori che esaminano e definiscono il lavoro digitale. Il concetto di lavoro digitale, inizialmente collegato a diverse forme di lavoro non materiale, precede la vita di dispositivi e sistemi complessi come l’intelligenza artificiale. Il lavoro digitale – il lavoro di costruzione e manutenzione dello stack di sistemi digitali – è tutt’altro che effimero o virtuale, ma è profondamente incarnato in diverse attività. 15 La portata è enorme: dal lavoro di migranti nelle miniere per l’estrazione dei minerali che costituiscono la base fisica delle tecnologie dell’informazione, al lavoro dei processi di produzione e assemblaggio dell’hardware, rigorosamente controllati e talvolta pericolosi, nelle fabbriche cinesi, ai lavoratori cognitivi sfruttati in outsourcing nei Paesi in via di sviluppo che etichettano le serie di dati di addestramento dell’intelligenza artificiale, fino ai lavoratori fisici informali che ripuliscono le discariche di rifiuti tossici. Questi processi creano nuovi accumuli di ricchezza e potere, che si concentrano in uno strato sociale molto sottile.

La dialettica di Marx tra soggetto e oggetto in economia.

La dialettica di Marx tra soggetto e oggetto in economia.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

X

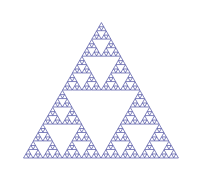

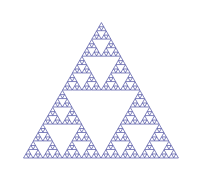

Questo triangolo di estrazione e produzione di valore rappresenta uno degli elementi fondamentali della nostra mappa, dalla nascita in un processo geologico, attraverso la vita come prodotto di consumo dell’intelligenza artificiale, fino alla morte in una discarica di rifiuti elettronici. Come nell’opera di Fuchs, i nostri triangoli non sono isolati, ma collegati tra loro nel processo di produzione. Formano un flusso ciclico in cui il prodotto del lavoro si trasforma in una risorsa, che si trasforma in un prodotto, che si trasforma in una risorsa e così via. Ogni triangolo rappresenta una fase del processo produttivo. Sebbene questo appaia sulla mappa come un percorso lineare di trasformazione, una metafora visiva diversa rappresenta meglio la complessità dell’estrattivismo attuale: la struttura frattale nota come triangolo di Sierpinski.

Una visualizzazione lineare non ci permette di mostrare che ogni fase successiva della produzione e dello sfruttamento contiene le fasi precedenti. Se guardiamo al sistema di produzione e sfruttamento attraverso una struttura visiva frattale, il triangolo più piccolo rappresenterebbe le risorse naturali e i mezzi di lavoro, cioè il minatore come lavoro e il minerale come prodotto. Il triangolo successivo, più grande, comprende la lavorazione dei metalli e quello successivo rappresenterebbe il processo di produzione dei componenti e così via. Il triangolo finale della nostra mappa, la produzione stessa dell’unità Amazon Echo, comprende tutti questi livelli di sfruttamento, dal basso fino al vertice di Amazon Inc, un ruolo abitato da Jeff Bezos in qualità di CEO di Amazon. Come un faraone dell’antico Egitto, egli si trova in cima alla più grande piramide di estrazione del valore dell’IA.

Triangolo di Sierpinski o frattale di Sierpinski

Triangolo di Sierpinski o frattale di Sierpinski

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

XI

Per tornare all’elemento di base di questa visualizzazione – una variazione del triangolo di produzione di Marx – ogni triangolo crea un surplus di valore per creare profitti. Se osserviamo la scala del reddito medio per ogni attività nel processo di produzione di un dispositivo, che è mostrata sul lato sinistro della nostra mappa, vediamo la drammatica differenza di reddito guadagnato. Secondo una ricerca di Amnesty International, durante l’estrazione del cobalto, utilizzato anche per le batterie al litio di 16 marche multinazionali, i lavoratori sono pagati l’equivalente di un dollaro USA al giorno per lavorare in condizioni pericolose per la vita e la salute, e spesso sono stati sottoposti a violenze, estorsioni e intimidazioni. 16 Amnesty ha documentato che nelle miniere lavorano bambini di soli 7 anni. Al contrario, l’amministratore delegato di Amazon Jeff Bezos, in cima alla nostra piramide frattale, ha guadagnato in media 275 milioni di dollari al giorno nei primi cinque mesi del 2018, secondo il Bloomberg Billionaires Index. 17 Un bambino che lavora in una miniera del Congo avrebbe bisogno di più di 700.000 anni di lavoro ininterrotto per guadagnare la stessa cifra di un solo giorno di reddito di Bezos.

Molti dei triangoli mostrati su questa mappa nascondono storie diverse di sfruttamento del lavoro e condizioni di lavoro disumane. Il prezzo ecologico della trasformazione degli elementi e delle disparità di reddito è solo uno dei possibili modi di rappresentare una profonda disuguaglianza sistemica. Entrambi abbiamo studiato diverse forme di “scatole nere” intese come processi algoritmici, ma questa mappa evidenzia un’altra forma di opacità: i processi stessi di creazione, formazione e funzionamento di un dispositivo come Amazon Echo sono essi stessi una sorta di scatola nera, molto difficile da esaminare e tracciare in toto dati i molteplici strati di appaltatori, distributori e partner logistici a valle in tutto il mondo. Come scrive Mark Graham, “il capitalismo contemporaneo nasconde ai consumatori le storie e le geografie della maggior parte delle merci. I consumatori sono di solito in grado di vedere le merci solo nel qui e ora del tempo e dello spazio, e raramente hanno l’opportunità di guardare indietro attraverso le catene di produzione per acquisire conoscenze sui luoghi di produzione, trasformazione e distribuzione”. 19

Un esempio della difficoltà di indagare e tracciare il processo della catena di produzione contemporanea è rappresentato dal fatto che Intel ha impiegato più di quattro anni per comprendere la sua linea di fornitura abbastanza bene da assicurarsi che nessun tantalio proveniente dal Congo fosse presente nei suoi microprocessori. In qualità di produttore di chip semiconduttori, Intel fornisce processori ad Apple. Per farlo, Intel dispone di una propria catena di approvvigionamento a più livelli, composta da oltre 19.000 fornitori in più di 100 Paesi, che forniscono materiali diretti per i processi di produzione, strumenti e macchinari per le fabbriche e servizi di logistica e imballaggio. 20 Il fatto che un’azienda leader nel settore tecnologico abbia impiegato più di quattro anni solo per comprendere la propria catena di fornitura rivela quanto questo processo possa essere difficile da comprendere dall’interno, per non parlare dei ricercatori esterni, dei giornalisti e degli accademici. Anche l’azienda tecnologica olandese Philips ha dichiarato di essere al lavoro per rendere la propria catena di approvvigionamento “priva di conflitti”. Philips, ad esempio, ha decine di migliaia di fornitori diversi, ognuno dei quali fornisce componenti diversi per i propri processi produttivi. 21 Questi fornitori sono a loro volta collegati a valle a decine di migliaia di produttori di componenti che acquistano i materiali da centinaia di raffinerie che acquistano gli ingredienti da diverse fonderie, che si riforniscono da un numero imprecisato di commercianti che hanno a che fare direttamente con operazioni di estrazione mineraria sia legali che illegali. In The Elements of Power, David S. Abraham descrive le reti invisibili dei commercianti di metalli rari nelle catene di fornitura dell’elettronica globale: “La rete per portare i metalli rari dalla miniera al vostro computer portatile viaggia attraverso una rete oscura di commercianti, trasformatori e produttori di componenti. I commercianti sono gli intermediari che non si limitano a comprare e vendere metalli rari: contribuiscono a regolare le informazioni e sono l’anello nascosto che aiuta a navigare nella rete tra le fabbriche di metalli e i componenti dei nostri computer portatili”. 22 Secondo l’azienda produttrice di computer Dell, le complessità della catena di approvvigionamento dei metalli pongono sfide quasi insormontabili. 23 L’estrazione di questi minerali avviene molto prima dell’assemblaggio del prodotto finale, rendendo estremamente difficile rintracciare l’origine dei minerali. Inoltre, molti minerali vengono fusi insieme a metalli riciclati, e a quel punto diventa praticamente impossibile risalire alla loro origine. Il tentativo di catturare l’intera catena di approvvigionamento è quindi un compito davvero gigantesco: rivela tutta la complessità della produzione globale di prodotti tecnologici del XXI secolo.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

XII

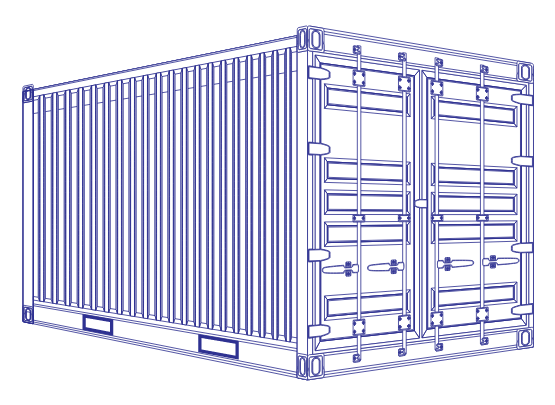

Le catene di fornitura sono spesso stratificate l’una sull’altra, in una rete tentacolare. Il programma dei fornitori di Apple rivela che ci sono decine di migliaia di singoli componenti incorporati nei suoi dispositivi, a loro volta forniti da centinaia di aziende diverse. Affinché ciascuno di questi componenti arrivi alla catena di montaggio finale, dove sarà assemblato dagli operai degli stabilimenti Foxconn, è necessario trasferire fisicamente i diversi componenti da oltre 750 siti di fornitori in 30 Paesi diversi. 24 Si tratta di una complessa struttura di catene di fornitura all’interno di catene di fornitura, un frattale che si ingrandisce con decine di migliaia di fornitori, milioni di chilometri di materiali spediti e centinaia di migliaia di lavoratori inclusi nel processo ancor prima che il prodotto venga assemblato sulla linea.

Visualizzando questo processo come un’unica rete globale, pan-continentale, attraverso la quale scorrono materiali, componenti e prodotti, vediamo un’analogia con la rete informatica globale. Dove c’è un singolo pacchetto Internet che viaggia verso un Amazon Echo, qui possiamo immaginare un singolo container. 25 Lo spettacolo vertiginoso della logistica e della produzione globale non sarebbe stato possibile senza l’invenzione di questo semplice oggetto metallico standardizzato. I container standardizzati hanno permesso l’esplosione dell’industria navale moderna, che ha reso possibile modellare il pianeta come un’unica, enorme fabbrica. Nel 2017, la capacità delle navi portacontainer nel commercio marittimo ha raggiunto quasi 250.000.000 di tonnellate di portata lorda, dominate da gigantesche compagnie di navigazione come la danese Maersk, la svizzera Mediterranean Shipping Company e la francese CMA CGM Group, ognuna delle quali possiede centinaia di navi portacontainer. 26 Per queste imprese commerciali, il trasporto merci è un modo relativamente economico di attraversare il sistema vascolare della fabbrica globale, ma nasconde costi esterni molto più grandi.

Negli ultimi anni, le navi da trasporto producono il 3,1% delle emissioni annue globali di CO2, più dell’intera Germania. 27 Per ridurre al minimo i costi interni, la maggior parte delle compagnie di navigazione di container utilizza carburante di qualità molto bassa in quantità enormi, il che comporta un aumento delle quantità di zolfo nell’aria, oltre ad altre sostanze tossiche. È stato stimato che una sola nave portacontainer può emettere una quantità di inquinamento pari a quella di 50 milioni di automobili e che ogni anno 60.000 morti in tutto il mondo sono attribuite indirettamente a problemi di inquinamento legati all’industria delle navi da carico. 28 Anche fonti amiche dell’industria, come il World Shipping Council, ammettono che ogni anno migliaia di container vanno persi, sul fondo dell’oceano o alla deriva. 29 Alcuni trasportano sostanze tossiche che si disperdono negli oceani. In genere, i lavoratori trascorrono dai 9 ai 10 mesi in mare, spesso con lunghi turni di lavoro e senza accesso a comunicazioni esterne. I lavoratori delle Filippine rappresentano più di un terzo della forza lavoro del trasporto marittimo globale. 30 I costi più gravi della logistica globale ricadono sull’atmosfera, sull’ecosistema oceanico e su tutto ciò che contiene e sui lavoratori, i meno pagati.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

XIII

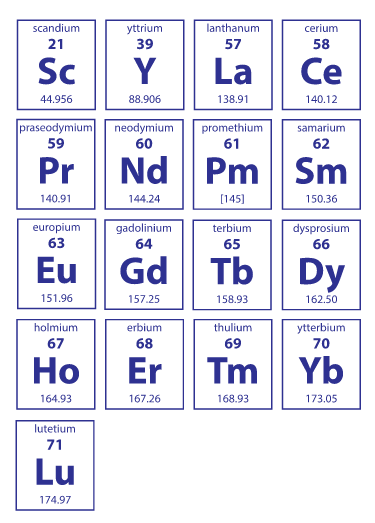

La crescente complessità e miniaturizzazione della nostra tecnologia dipende da un processo che stranamente fa risuonare le speranze dell’alchimia medievale. Mentre gli alchimisti medievali miravano a trasformare i metalli di base in metalli “nobili”, oggi i ricercatori utilizzano i metalli delle terre rare per migliorare le prestazioni di altri minerali. Esistono 17 elementi delle terre rare, che sono incorporati nei computer portatili e negli smartphone, rendendoli più piccoli e leggeri. Sono presenti nei display a colori, negli altoparlanti, negli obiettivi delle fotocamere, nei sistemi GPS, nelle batterie ricaricabili, nei dischi rigidi e in molti altri componenti. Sono elementi chiave nei sistemi di comunicazione, dai cavi in fibra ottica all’amplificazione del segnale nelle torri di comunicazione mobile, fino ai satelliti e alla tecnologia GPS. Ma la configurazione e l’uso precisi di questi minerali sono difficili da accertare. Così come gli alchimisti medievali nascondevano le loro ricerche dietro cifrari e simbolismi criptici, i processi contemporanei di utilizzo dei minerali nei dispositivi sono protetti da NDA (Non-Disclosure-Agreement) e segreti commerciali.

Le caratteristiche elettroniche, ottiche e magnetiche uniche degli elementi delle terre rare non possono essere eguagliate da nessun altro metallo o sostituto sintetico finora scoperto. Sebbene siano chiamati “metalli delle terre rare”, alcuni sono relativamente abbondanti nella crosta terrestre, ma l’estrazione è costosa e altamente inquinante. David Abraham descrive l’estrazione del disprosio e del terbio, utilizzati in una serie di dispositivi high-tech, a Jianxi, in Cina. Scrive: “Solo lo 0,2% dell’argilla estratta contiene i preziosi elementi delle terre rare. Ciò significa che il 99,8% della terra rimossa nelle miniere di terre rare viene scartata sotto forma di rifiuti chiamati “sterili” che vengono riversati nelle colline e nei corsi d’acqua”, creando nuovi inquinanti come l’ammonio. 31 Per raffinare una tonnellata di terre rare, “la Società cinese delle terre rare stima che il processo produca 75.000 litri di acqua acida e una tonnellata di residui radioattivi”. 32 Inoltre, le attività di estrazione e raffinazione consumano grandi quantità di acqua e generano grandi quantità di emissioni di CO2. Nel 2009, la Cina ha prodotto il 95% della fornitura mondiale di questi elementi e si stima che la singola miniera nota come Bayan Obo contenga il 70% delle riserve mondiali. 33

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

XIV

Un’immagine satellitare della minuscola isola indonesiana di Bangka racconta il tributo umano e ambientale della produzione di semiconduttori. Su questa minuscola isola, i minatori, per lo più “informali”, si trovano su galleggianti di fortuna, usano pali di bambù per raschiare il fondale marino e poi si immergono sott’acqua per aspirare lo stagno dalla superficie attraverso tubi giganti simili al vuoto. Come riporta un’inchiesta del Guardian, “l’estrazione dello stagno è un commercio lucrativo ma distruttivo che ha sfregiato il paesaggio dell’isola, raso al suolo le sue fattorie e le sue foreste, ucciso gli stock ittici e le barriere coralline e intaccato il turismo sulle sue graziose spiagge ornate di palme”. I danni si vedono meglio dall’alto, quando sacche di foresta lussureggiante si nascondono tra enormi distese di terra arancione e brulla. Dove non è dominata dalle miniere, è costellata di tombe, molte delle quali contengono i corpi dei minatori che sono morti nel corso dei secoli scavando per lo stagno”. 34 Due piccole isole, Bangka e Belitung, producono il 90% dello stagno indonesiano e l’Indonesia è il secondo esportatore mondiale di questo metallo. La società nazionale indonesiana dello stagno, PT Timah, rifornisce direttamente aziende come Samsung e i produttori di saldature Chernan e Shenmao, che a loro volta riforniscono Sony, LG e Foxconn. 35

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

XV

Nei centri di distribuzione di Amazon, vaste collezioni di prodotti sono disposte in ordine computazionale su milioni di scaffali. La posizione di ogni articolo in questo spazio è determinata con precisione da complesse funzioni matematiche che elaborano le informazioni sugli ordini e creano relazioni tra i prodotti. L’obiettivo è ottimizzare i movimenti dei robot e degli esseri umani che collaborano in questi magazzini. Con l’aiuto di un braccialetto elettronico, il lavoratore umano viene guidato in magazzini grandi come hangar di aerei, pieni di oggetti disposti secondo un ordine algoritmico opaco. 36

Nascosto tra le migliaia di altri brevetti pubblicamente disponibili di proprietà di Amazon, il brevetto statunitense numero 9.280.157 rappresenta una straordinaria illustrazione dell’alienazione dei lavoratori, un momento cruciale nel rapporto tra uomini e macchine. 37 Il brevetto raffigura una gabbia metallica destinata al lavoratore, dotata di diversi componenti cibernetici, che può essere spostata in un magazzino dallo stesso sistema motorizzato che sposta gli scaffali pieni di merce. In questo caso, il lavoratore diventa parte di un balletto macchinico, tenuto in piedi in una gabbia che detta e vincola il suo movimento.

Come abbiamo visto più volte nella ricerca per la nostra mappa, i futuri distopici sono costruiti sui regimi distopici distribuiti in modo diseguale del passato e del presente, sparsi in una serie di catene di produzione per i moderni dispositivi tecnici. I pochi che si trovano in cima alla piramide frattale dell’estrazione di valore vivono in una straordinaria ricchezza e comodità. Ma la maggior parte delle piramidi è fatta dai tunnel bui delle miniere, dai laghi di rifiuti radioattivi, dai container navali dismessi e dai dormitori delle fabbriche aziendali.

Brevetto Amazon numero 20150066283 A1

Brevetto Amazon numero 20150066283 A1

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

XVI

Alla fine del XIX secolo, un particolare albero del Sud-Est asiatico chiamato palaquium gutta divenne il centro di un boom tecnologico. Questi alberi, che si trovano principalmente in Malesia, producono un lattice naturale bianco lattiginoso chiamato guttaperca. Dopo che lo scienziato inglese Michael Faraday pubblicò nel 1848 uno studio sull’uso di questo materiale come isolante elettrico, la guttaperca divenne rapidamente il beniamino del mondo dell’ingegneria. Fu vista come la soluzione al problema di isolare i cavi telegrafici in modo che potessero resistere alle condizioni del fondo dell’oceano. Con la crescita dell’attività sottomarina globale, aumentò anche la domanda di tronchi di palaquium gutta. Lo storico John Tully descrive come i lavoratori locali malesi, cinesi e dayak venissero pagati poco per il pericoloso lavoro di abbattimento degli alberi e la lenta raccolta del lattice. 38 Il lattice veniva lavorato e poi venduto attraverso i mercati commerciali di Singapore al mercato britannico, dove veniva trasformato, tra le altre cose, in lunghe guaine per cavi sottomarini.

Una gutta palaquium matura poteva produrre circa 300 grammi di lattice. Ma nel 1857, il primo cavo transatlantico era lungo circa 3000 km e pesava 2000 tonnellate, il che richiedeva circa 250 tonnellate di guttaperca. Per produrre una sola tonnellata di questo materiale erano necessari circa 900.000 tronchi d’albero. Le giungle della Malesia e di Singapore vennero spogliate e all’inizio degli anni Ottanta del XIX secolo la gutta perca del Palaquium era scomparsa. In un ultimo tentativo di salvare la propria catena di approvvigionamento, nel 1883 gli inglesi promossero un divieto per fermare la raccolta del lattice, ma l’albero era già estinto. 39

Il disastro ambientale vittoriano della guttaperca, dalle prime origini della società dell’informazione globale, mostra come le relazioni tra la tecnologia e la sua materialità, gli ambienti e le diverse forme di sfruttamento siano impregnate. Proprio come i vittoriani hanno provocato un disastro ecologico per i loro primi cavi, così l’estrazione di terre rare e le catene di approvvigionamento globali mettono ulteriormente a rischio il delicato equilibrio ecologico della nostra epoca. Dai materiali utilizzati per costruire la tecnologia che consente la società contemporanea in rete, all’energia necessaria per trasmettere, analizzare e immagazzinare i dati che scorrono attraverso l’enorme infrastruttura, alla materialità dell’infrastruttura: queste connessioni profonde e i costi sono più significativi e hanno una storia molto più lunga di quella solitamente rappresentata nell’immaginario aziendale dell’IA. 40

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

XVII

I sistemi di intelligenza artificiale su larga scala consumano enormi quantità di energia. Tuttavia, i dettagli materiali di questi costi rimangono vaghi nell’immaginario sociale. Rimane difficile ottenere dettagli precisi sulla quantità di energia consumata dai servizi di cloud computing. Un rapporto di Greenpeace afferma che: “Uno dei maggiori ostacoli alla trasparenza del settore è rappresentato da Amazon Web Services (AWS). La più grande azienda di cloud computing al mondo rimane quasi del tutto non trasparente sull’impronta energetica delle sue enormi operazioni. Tra i fornitori globali di cloud, solo AWS si rifiuta ancora di rendere pubblici i dettagli di base sulle prestazioni energetiche e sull’impatto ambientale associato alle sue operazioni”. 41

Come agenti umani, siamo visibili in quasi tutte le interazioni con le piattaforme tecnologiche. Siamo sempre tracciati, quantificati, analizzati e mercificati. Ma in contrasto con la visibilità degli utenti, i dettagli precisi sulle fasi di nascita, vita e morte dei dispositivi in rete sono oscurati. Con i dispositivi emergenti, come l’Echo, che si affidano a un’infrastruttura IA centralizzata e lontana dalla vista, ancora più dettagli cadono nell’ombra.

Mentre i consumatori si abituano a un piccolo dispositivo hardware nel loro salotto, o a un’applicazione telefonica, o a un’auto semi-autonoma, il vero lavoro viene svolto all’interno di sistemi di apprendimento automatico che sono generalmente lontani dall’utente e totalmente invisibili a quest’ultimo. In molti casi, la trasparenza non servirebbe a molto: senza forme di scelta reale e di responsabilità aziendale, la semplice trasparenza non sposterà il peso delle attuali asimmetrie di potere. 42

I risultati dei sistemi di apprendimento automatico sono prevalentemente non rendicontabili e non governati, mentre gli input sono enigmatici. A un osservatore casuale, sembra che costruire sistemi basati sull’IA o sull’apprendimento automatico non sia mai stato così facile come oggi. La disponibilità di strumenti open-source per farlo, in combinazione con la potenza di calcolo affittabile attraverso superpotenze del cloud come Amazon (AWS), Microsoft (Azure) o Google (Google Cloud), sta facendo nascere la falsa idea della “democratizzazione” dell’IA. Mentre gli strumenti di apprendimento automatico “off the shelf”, come TensorFlow, stanno diventando più accessibili dal punto di vista della creazione del proprio sistema, le logiche sottostanti a tali sistemi e i set di dati per il loro addestramento sono accessibili e controllati da pochissime entità. Nella dinamica di raccolta dei set di dati attraverso piattaforme come Facebook, gli utenti alimentano e addestrano le reti neurali con dati comportamentali, voce, immagini e video taggati o dati medici. In un’epoca di estrattivismo, il valore reale di questi dati è controllato e sfruttato da pochissimi soggetti al vertice della piramide.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

XVIII

Quando si utilizzano enormi insiemi di dati per addestrare i sistemi di intelligenza artificiale, le singole immagini e i video coinvolti vengono comunemente etichettati e contrassegnati. 43 Ci sarebbe molto da dire sul modo in cui questo processo di etichettatura abroga e cristallizza il significato e, inoltre, sul modo in cui questo processo è guidato dai lavoratori dei click che vengono pagati frazioni di centesimo per questo lavoro digitale a cottimo.

Nel 1770, l’inventore ungherese Wolfgang von Kempelen costruì una macchina per giocare a scacchi nota come Turco meccanico. Il suo obiettivo, in parte, era quello di impressionare l’imperatrice Maria Teresa d’Austria. Questo dispositivo era in grado di giocare a scacchi contro un avversario umano ed ebbe un successo spettacolare vincendo la maggior parte delle partite giocate durante le sue dimostrazioni in Europa e nelle Americhe per quasi nove decenni. Ma il Turco Meccanico era un’illusione che permetteva a un maestro di scacchi umano di nascondersi all’interno della macchina e di farla funzionare. Circa 160 anni più tardi, Amazon.com ha lanciato la sua piattaforma di crowdsourcing basata su micropagamenti con lo stesso nome. Secondo Ayhan Aytes, la motivazione iniziale di Amazon per costruire Mechanical Turk è emersa dopo il fallimento dei suoi programmi di intelligenza artificiale nel compito di trovare pagine di prodotti duplicate sul suo sito web di vendita al dettaglio. 44 Dopo una serie di tentativi inutili e costosi, gli ingegneri del progetto si sono rivolti agli esseri umani per lavorare dietro ai computer all’interno di un sistema razionalizzato basato sul web. 45 L’officina digitale Amazon Mechanical Turk emula i sistemi di intelligenza artificiale controllando, valutando e correggendo i processi di apprendimento automatico con la forza del cervello umano. Con Amazon Mechanical Turk, agli utenti può sembrare che un’applicazione utilizzi un’intelligenza artificiale avanzata per svolgere dei compiti. Ma è più vicina a una forma di “intelligenza artificiale”, guidata da una forza lavoro remota, dispersa e mal pagata che aiuta i clienti a raggiungere i loro obiettivi aziendali. Come osservato da Aytes, “in entrambi i casi [sia il Mechanical Turk del 1770 che la versione contemporanea del servizio di Amazon] le prestazioni dei lavoratori che animano l’artificio sono oscurate dallo spettacolo della macchina”. 46

Questo tipo di lavoro invisibile e nascosto, in outsourcing o in crowdsourcing, celato dietro le interfacce e mimetizzato all’interno dei processi algoritmici, è ormai comune, in particolare nel processo di etichettatura di migliaia di ore di archivi digitali per alimentare le reti neurali. A volte questo lavoro è interamente non retribuito, come nel caso del reCAPTCHA di Google. In un paradosso che molti di noi hanno sperimentato, per dimostrare di non essere un agente artificiale, si è costretti ad addestrare gratuitamente il sistema AI di riconoscimento delle immagini di Google, selezionando più caselle che contengono numeri civici, o automobili, o case.

Come vediamo ripetersi in tutto il sistema, le forme contemporanee di intelligenza artificiale non sono poi così artificiali. Possiamo parlare del duro lavoro fisico dei lavoratori delle miniere e del lavoro ripetitivo delle catene di montaggio, del lavoro cibernetico nei centri di distribuzione e delle officine cognitive piene di programmatori in outsourcing in tutto il mondo, del lavoro in crowdsourcing poco pagato dei lavoratori di Mechanical Turk o del lavoro immateriale non retribuito degli utenti. A ogni livello, la tecnologia contemporanea è profondamente radicata nello sfruttamento dei corpi umani e si regge su di esso.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

XIX

Nel suo racconto di un solo paragrafo “Sull’esattezza nella scienza”, Jorge Luis Borges ci presenta un impero immaginario in cui la scienza cartografica è diventata così sviluppata e precisa da aver bisogno di una mappa della stessa scala dell’impero stesso. 47

“In quell’impero, l’arte della cartografia raggiunse una tale perfezione che la mappa di una singola provincia occupava la totalità di una città, e la mappa dell’impero la totalità di una provincia. Col tempo, quelle mappe inconcepibili non soddisfacevano più, e le Gilde dei Cartografi realizzarono una mappa dell’Impero le cui dimensioni erano quelle dell’Impero e che coincidevano punto per punto con esso. Le generazioni successive, che non amavano lo studio della cartografia come i loro antenati, videro che quella vasta mappa era inutile, e non senza una certa spietatezza la consegnarono alle inclemenze del sole e degli inverni. Nei deserti dell’Occidente, ancora oggi, ci sono brandelli di quella mappa, abitati da animali e mendicanti; in tutta la terra non c’è nessun’altra reliquia delle discipline della geografia”.

Gli attuali approcci all’apprendimento automatico sono caratterizzati dall’aspirazione a mappare il mondo, una quantificazione completa dei regimi visivi, uditivi e di riconoscimento della realtà. Dal modello cosmologico dell’universo al mondo delle emozioni umane interpretate attraverso i più piccoli movimenti muscolari del volto umano, tutto diventa oggetto di quantificazione. Jean-François Lyotard ha introdotto l’espressione “affinità con l’infinito” per descrivere come l’arte contemporanea, la tecno-scienza e il capitalismo condividano la stessa aspirazione a spingere i confini verso un orizzonte potenzialmente infinito. 48 La seconda metà del XIX secolo, con la sua attenzione alla costruzione di infrastrutture e alla transizione disomogenea verso la società industrializzata, ha generato enormi ricchezze per un ristretto numero di magnati industriali che hanno monopolizzato lo sfruttamento delle risorse naturali e i processi produttivi.

Il nuovo orizzonte infinito è l’estrazione dei dati, l’apprendimento automatico e la riorganizzazione delle informazioni attraverso sistemi di intelligenza artificiale che combinano l’elaborazione umana e quella meccanica. I territori sono dominati da poche mega-aziende globali, che stanno creando nuove infrastrutture e meccanismi per l’accumulo di capitale e lo sfruttamento delle risorse umane e planetarie.

Questa sete sfrenata di nuove risorse e campi di sfruttamento cognitivo ha spinto la ricerca di strati sempre più profondi di dati che possono essere utilizzati per quantificare la psiche umana, conscia e inconscia, privata e pubblica, idiosincratica e generale. In questo modo, abbiamo assistito all’emergere di molteplici economie cognitive: l’economia dell’attenzione, 49 l’economia della sorveglianza, l’economia della reputazione 50 e l’economia delle emozioni, nonché la quantificazione e la mercificazione della fiducia e delle prove attraverso le criptovalute.

Il processo di quantificazione si estende sempre più al mondo affettivo, cognitivo e fisico dell’uomo. Esistono set di addestramento per il rilevamento delle emozioni, per la somiglianza familiare, per seguire l’invecchiamento di un individuo e per le azioni umane come sedersi, salutare, alzare un bicchiere o piangere. Ogni forma di dati anagrafici – compresi quelli forensi, biometrici, sociometrici e psicometrici – viene acquisita e registrata in database per l’addestramento delle IA. Questa quantificazione spesso si basa su basi molto limitate: insiemi di dati come AVA che mostrano principalmente le donne nella categoria di azioni “giocare con i bambini” e gli uomini nella categoria “prendere a calci una persona”. Gli insiemi di addestramento per i sistemi di IA pretendono di raggiungere la natura a grana fine della vita quotidiana, ma ripetono i modelli sociali più stereotipati e limitati, reinscrivendo una visione normativa del passato umano e proiettandola nel futuro umano.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

XX

La “recinzione” della biodiversità e della conoscenza è il passo finale di una serie di recinzioni iniziate con l’avvento del colonialismo. La terra e le foreste sono state le prime risorse a essere ‘racchiuse’ e convertite da beni comuni a merci. In seguito, le risorse idriche sono state “racchiuse” attraverso dighe, estrazione di acque sotterranee e schemi di privatizzazione. Ora è il turno della biodiversità e della conoscenza di essere ‘racchiuse’ attraverso i diritti di proprietà intellettuale (DPI)”, spiega Vandana Shiva. 51 Secondo le parole di Shiva, “la distruzione dei beni comuni è stata essenziale per la rivoluzione industriale, per fornire un approvvigionamento di risorse naturali come materia prima all’industria. Un sistema di supporto alla vita può essere condiviso, non può essere posseduto come proprietà privata o sfruttato per profitto privato. I beni comuni, quindi, dovevano essere privatizzati e la base di sostentamento delle persone in questi beni comuni doveva essere appropriata, per alimentare il motore del progresso industriale e dell’accumulazione di capitale”. 52

Mentre Shiva si riferisce alla chiusura della natura da parte dei diritti di proprietà intellettuale, lo stesso processo si sta verificando con l’apprendimento automatico – un’intensificazione della natura quantificata. La nuova corsa all’oro nel contesto dell’intelligenza artificiale consiste nel racchiudere diversi campi del sapere, del sentire e dell’agire umano, al fine di catturare e privatizzare tali campi. Quando nel novembre 2015 DeepMind Technologies Ltd. ha avuto accesso alle cartelle cliniche di 1,6 milioni di pazienti identificabili dell’ospedale Royal Free, abbiamo assistito a una particolare forma di privatizzazione: l’estrazione del valore della conoscenza.53 Un set di dati può ancora essere di proprietà pubblica, ma il meta-valore dei dati – il modello creato da essi – è di proprietà privata. Sebbene ci siano molte buone ragioni per cercare di migliorare la salute pubblica, c’è un rischio reale se ciò avviene a costo di una privatizzazione furtiva dei servizi medici pubblici. Si tratta di un futuro in cui il lavoro umano esperto a livello locale nel sistema pubblico viene aumentato e talvolta sostituito da sistemi di intelligenza artificiale aziendali centralizzati e di proprietà privata, che utilizzano i dati pubblici per generare enormi ricchezze per pochi.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

XXI

In questo momento del XXI secolo, assistiamo a una nuova forma di estrattivismo che è ben avviata: una forma di estrattivismo che raggiunge gli angoli più remoti della biosfera e gli strati più profondi dell’essere cognitivo e affettivo umano. Molte delle ipotesi sulla vita umana formulate dai sistemi di apprendimento automatico sono ristrette, normative e cariche di errori. Tuttavia, essi stanno iscrivendo e costruendo tali presupposti in un nuovo mondo e svolgeranno sempre più un ruolo nel modo in cui vengono distribuite le opportunità, la ricchezza e la conoscenza.

Lo stack necessario per interagire con un Amazon Echo va ben oltre lo “stack tecnico” a più livelli di modellazione dei dati, hardware, server e reti. Lo stack completo si estende molto di più al capitale, al lavoro e alla natura, e richiede un’enorme quantità di ciascuno di essi. I veri costi di questi sistemi – sociali, ambientali, economici e politici – rimangono nascosti e potrebbero rimanere tali per qualche tempo.

Offriamo questa mappa e questo saggio come un modo per iniziare a vedere attraverso una gamma più ampia di estrazioni del sistema. La scala richiesta per costruire sistemi di intelligenza artificiale è troppo complessa, troppo oscurata dalle leggi sulla proprietà intellettuale e troppo impantanata nella complessità logistica per essere compresa appieno in questo momento. Eppure vi attingete ogni volta che impartite un semplice comando vocale a un piccolo cilindro nel vostro salotto: “Alexa, che ore sono?”.

E così il ciclo continua.

https://anatomyof.ai/

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

Note

- 1 Kate Crawford is a Distinguished Research Professor at New York University, a Principal Researcher at Microsoft Research New York, and the co-founder and co-director of the AI Now Institute at NYU.

- 2 Vladan Joler is a professor at the Academy of Arts at the University of Novi Sad and founder of SHARE Foundation. He is leading SHARE Lab, a research and data investigation lab for exploring different technical and social aspects of algorithmic transparency, digital labor exploitation, invisible infrastructures, and technological black boxes.

- 3 Amazon advertising campaign, “All-New Amazon Echo”, September 27, 2017, https://www.youtube.com/watch?v=IyvZ41XjUjY.

- 4 Emily Achtenberg, “Bolivia Bets on State-Run Lithium Industry,” NACLA, November 15, 2010, https://nacla.org/news/bolivia-bets-state-run-lithium-industry.

- 5 Christine Negroni, “How to Determine the Power Rating of Your Gadget’s Batteries,” The New York Times, December 22, 2017, https://www.nytimes.com/2016/12/26/business/lithium-ion-battery-airline-safety.html.

- 6 Jessica Shankleman et al., “We’re Going to Need More Lithium,” Bloomberg, September 7, 2017, https://www.bloomberg.com/graphics/2017-lithium-battery-future/.

- 7 Nicola Clark and Simon Wallis, “Flamingos, Salt Lakes and Volcanoes: Hunting for Evidence of Past Climate Change on the High Altiplano of Bolivia,” Geology Today 33, no. 3 (May 1, 2017): 104, https://doi.org/10.1111/gto.12186.

- 8 Kate Davies and Liam Young, Tales from the Dark Side of the City: The Breastmilk of the Volcano Bolivia and the Atacama Desert Expedition (London: Unknown Fields, 2016).

- 9 Vincent Mosco, To the Cloud: Big Data in a Turbulent World (Boulder: Paradigm, 2014).

- 10 Sandro Mezzadra and Brett Neilson, “On the Multiple Frontiers of Extraction: Excavating Contemporary Capitalism,” Cultural Studies 31, no. 2–3 (May 4, 2017): 185, https://doi.org/10.1080/09502386.2017.1303425.

- 11 Lamberto Tronchin, “The ‘Phonurgia Nova’ of Athanasius Kircher: The Marvellous Sound World of 17th Century,” Proceedings of Meetings on Acoustics 4, no. 1 (June 29, 2008), 4: 015002, https://doi.org/10.1121/1.2992053.

- 12 Marshall McLuhan, Understanding Media: The Extensions of Man (New York: Signet Books, 1964).

- 13 Jussi Parikka, A Geology of Media (Minneapolis: University Of Minnesota Press, 2015), vii-viii.

- 14 Chris Ely, “The Life Expectancy of Electronics,” Consumer Technology Association, September 16, 2014, https://www.cta.tech/News/Blog/Articles/2014/September/The-Life-Expectancy-of-Electronics.aspx.

- 15 Christian Fuchs, Digital Labor and Karl Marx (London: Routledge, 2014).

- 16 “This Is What We Die For: Human Rights Abuses in the Democratic Republic of the Congo Power the Global Trade in Cobalt” (London: Amnesty International, 2016), https://www.amnesty.org/download/Documents/AFR6231832016ENGLISH.PDF. For an anthropological description of these mining processes, see: Jeffrey W. Mantz, “Improvisational Economies: Coltan Production in the Eastern Congo,” Social Anthropology 16, no. 1 (February 1, 2008): 34–50, https://doi.org/10.1111/j.1469-8676.2008.00035.x.

- 17 Julia Glum, “The Median Amazon Employee’s Salary Is $28,000. Jeff Bezos Makes More Than That in 10 Seconds,” Time, May 2, 2018, http://time.com/money/5262923/amazon-employee-median-salary-jeff-bezos/.

- 18F rank Pasquale, The Black Box Society: The Secret Algorithms That Control Money and Information (Cambridge, MA: Harvard University Press, 2016).

- 19 Mark Graham and Håvard Haarstad, “Transparency and Development: Ethical Consumption through Web 2.0 and the Internet of Things,” Information Technologies & International Development 7, no. 1 (March 10, 2011): 1.

- 20 “Intel’s Efforts to Achieve a ‘Conflict Free’ Supply Chain” (Santa Clara, CA: Intel Corporation, May 2018), https://www.intel.com/content/www/us/en/corporate-responsibility/conflict-minerals-white-paper.html.

- 21 “We Are Working to Make Our Supply Chain ‘Conflict-Free,’” Philips, 2018, https://www.philips.com/a-w/about/company/suppliers/supplier-sustainability/our-programs/conflict-minerals.html.

- 22 David S. Abraham, The Elements of Power: Gadgets, Guns, and the Struggle for a Sustainable Future in the Rare Metal Age, Reprint edition (Yale University Press, 2017), 89.

- 23 “Responsible Minerals Sourcing,” Dell, 2018, http://www.dell.com/learn/us/en/uscorp1/conflict-minerals?s=corp.

- 24 “Apple Supplier Responsibility 2018 Progress Report” (Cupertino CA: Apple, 2018), https://www.apple.com/supplier-responsibility/pdf/Apple_SR_2018_Progress_Report.pdf.

- 25 Alexander Klose, The Container Principle: How a Box Changes the Way We Think, trans. Charles Marcum II (Cambridge, MA: The MIT Press, 2015).

- 26 “Review of Maritime Transport 2017” (New York and Geneva: United Nations, 2017), http://unctad.org/en/PublicationsLibrary/rmt2017_en.pdf.

- 27Z oë Schlanger, “If Shipping Were a Country, It Would Be the Sixth-Biggest Greenhouse Gas Emitter,” Quartz, April 17, 2018.

- 28 John Vidal, “Health Risks of Shipping Pollution Have Been ‘Underestimated,’” The Guardian, April 9, 2009, sec. Environment, http://www.theguardian.com/environment/2009/apr/09/shipping-pollution.

- 29 “Containers Lost At Sea – 2017 Update” (World Shipping Council, July 10, 2017), http://www.worldshipping.org/industry-issues/safety/Containers_Lost_at_Sea_-_2017_Update_FINAL_July_10.pdf.

- 30 Rose George, Ninety Percent of Everything: Inside Shipping, the Invisible Industry That Puts Clothes on Your Back, Gas in Your Car, and Food on Your Plate (New York: Metropolitan Books, 2013), 22. Similar to our habit to neglect materiality of internet infrastructure and information technology, shipping industry is rarely represented in popular culture. Rose George calls this condition, “sea blindness” (2013, 4).

- 31 id., 175.

- 32 Ibid., Ib 176.

- 33 Chris Lo, “The False Monopoly: China and the Rare Earths Trade,” Mining Technology, August 19, 2015, https://www.mining-technology.com/features/featurethe-false-monopoly-china-and-the-rare-earths-trade-4646712/.

- 34 Kate Hodal, “Death Metal: Tin Mining in Indonesia,” The Guardian, November 23, 2012, http://www.theguardian.com/environment/2012/nov/23/tin-mining-indonesia-bangka.

- 35 Cam Simpson, “The Deadly Tin Inside Your Smartphone,” Bloomberg, August 24, 2012, https://www.bloomberg.com/news/articles/2012-08-23/the-deadly-tin-inside-your-smartphone.

- 36 Marcus Wohlsen, “A Rare Peek Inside Amazon’s Massive Wish-Fulfilling Machine,” Wired, June 16, 2014, https://www.wired.com/2014/06/inside-amazon-warehouse/.

- 37 Wurman, Peter R. et al., System and Method for Transporting Personnel Within an Active Workspace, US 9,280,157 B2 (Reno, NV, filed September 4, 2013, and issued March 8, 2016), http://pdfpiw.uspto.gov/.piw?Docid=09280157.

- 38 John Tully, “A Victorian Ecological Disaster: Imperialism, the Telegraph, and Gutta-Percha,” Journal of World History 20, no. 4 (December 23, 2009): 559–79, https://doi.org/10.1353/jwh.0.0088.

- 39 Ibid., 574.

- 40 See Nicole Starosielski, The Undersea Network (Durham: Duke University Press Books, 2015).

- 41 Gary Cook, “Clicking Clean: Who Is Winning the Race to Build a Green Internet?” (Washington, DC: Greenpeace, January 2017), 30, https://storage.googleapis.com/p4-production-content/international/wp-content/uploads/2017/01/35f0ac1a-clickclean2016-hires.pdf.

- 42 Mike Ananny and Kate Crawford, “Seeing without knowing: Limitations of the transparency ideal and its application to algorithmic accountability,” New Media & Society 20.3 (2018): 973-989.

- 43 Olga Russakovsky et al., “ImageNet Large Scale Visual Recognition Challenge,” International Journal of Computer Vision 115, no. 3 (December 1, 2015): 216, https://doi.org/10.1007/s11263-015-0816-y.

- 44 Ayhan Aytes, “Return of the Crowds: Mechanical Turk and Neoliberal States of Exception,” in Digital Labor: The Internet as Playground and Factory, ed. Trebor Scholz (London: Routledge, 2012), 80.

- 45 Jason Pontin, “Artificial Intelligence, With Help From the Humans,” The New York Times, March 25, 2007, sec. Business Day, https://www.nytimes.com/2007/03/25/business/yourmoney/25Stream.html.

- 46 Aytes, “Return of the Crowds,” 81.

- 47 Jorge Luis Borges, “On Exactitude in Science,” in Collected Fictions, trans. Andrew Hurley (New York: Penguin, 1999), 325.

- 48 Jean Francois Lyotard, “Presenting the Unpresentable: The Sublime,” Artforum, April 1982.

- 49 Yves Citton, The Ecology of Attention (Cambridge, UK: Polity, 2017).

- 50 Shoshana Zuboff, “Big Other: Surveillance Capitalism and the Prospects of an Information Civilization,” Journal of Information Technology 30, no. 1 (March 1, 2015): 75–89, https://doi.org/10.1057/jit.2015.5.

- 51 Vandana Shiva, The Enclosure and Recovery of The Commons: Biodiversity, Indigenous Knowledge, and Intellectual Property Rights (Research Foundation for Science, Technology, and Ecology, 1997).

- 52 Vandana Shiva, Protect or Plunder: Understanding Intellectual Property Rights (New York: Zed Books, 2001).

- 53 Alex Hern, “Royal Free Breached UK Data Law in 1.6m Patient Deal with Google’s DeepMind,” The Guardian, July 3, 2017, sec. Technology, http://www.theguardian.com/technology/2017/jul/03/google-deepmind-16m-patient-royal-free-deal-data-protection-act.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

Download

Versione PDF della mappa

https://anatomyof.ai/img/ai-anatomy-map.pdf

__________________________________________________________________________

https://anatomyof.ai/img/ai-anatomy-publication.pdf

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

Riconoscimenti e ringraziamenti

__________________________________________________________________________

Authors: Kate Crawford and Vladan Joler

Maps and design: Vladan Joler and Kate Crawford

Published by: SHARE Lab, SHARE Foundation (https://labs.rs) and The AI Now Institute, NYU (https://ainowinstitute.org/)

Full citation: Kate Crawford and Vladan Joler, “Anatomy of an AI System: The Amazon Echo As An Anatomical Map of Human Labor, Data and Planetary Resources,” AI Now Institute and Share Lab, (September 7, 2018) https://anatomyof.ai

Ringraziamenti: I nostri profondi ringraziamenti vanno a Michelle Thorne e Jon Rogers della Mozilla Foundation, che ci hanno invitato a un ritiro nell’estate 2017 dove abbiamo concettualizzato per la prima volta questo progetto. Grazie a Joana Moll e Meredith Whittaker per i loro input e le loro ispirazioni sulle prime bozze di questo testo. Grazie anche a tutti coloro che da allora ci hanno fornito feedback, supporto e spunti, tra cui Alex Campolo, Casey Gollan, Gretchen Krueger, Trevor Paglen e Sarah Myers West dell’AI Now Institute e Olivia Solis, Andrej Petrovski e Milica Jovanovic dello SHARE Lab e tutti i meravigliosi collaboratori della SHARE Foundation.

Infine, grazie a Irini Papadimitriou e a tutto lo staff curatoriale del V&A Museum. La mappa e il saggio saranno esposti nell’ambito della mostra “Artificially Intelligent” dal 6 settembre al 31 dicembre 2018.

▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬

Anatomia di un sistema di intelligenza artificiale

Threat Modeling workshop

Cos’è il threat modeling

È un processo con cui identificare potenziali minacce e vulnerabilità, valutare quanto sono serie/probabili nel caso specifico, metterle in una scala di priorità, e ridurre il rischio che si avverino prendendo delle contromisure. In genere lo si fa per sistemi/software/prodotti, e al riguardo c’è una discreta letteratura in materia (ad esempio, Threat Modeling: Designing for Security di Adam Shostack, un manuale fondamentale, e piuttosto tecnico, rivolto soprattutto a sviluppatori ecc).

Ma lo si può applicare anche a organizzazioni e persone, sebbene qui la disciplina sia meno sistematizzata e nel caso delle persone tenda a sovrapporsi alle misure per mettere in sicurezza le proprie attività online (denominate operation security o opsec).

Qui in particolare ci interessa l’applicazione alle persone. In questa accezione, tutti noi già facciamo threat modeling (le donne poi lo fanno tantissimo). Quando valutiamo che via prendere per tornare la sera, quanto è sicura, quanto ci espone tornare a piedi da soli, che mezzi abbiamo eventualmente per evitare (o difenderci da) una aggressione. Questo è threat modeling di strada.

Siamo invece meno abituati ad applicarlo nella nostra vita digitale. Eppure imparare a farlo aiuta molto di più della solita lista di consigli, che finiscono con l’essere indicazioni generiche e inascoltate. Il threat modeling invece è alla base di una cultura della sicurezza, anche individuale.

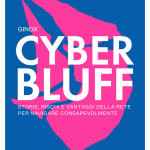

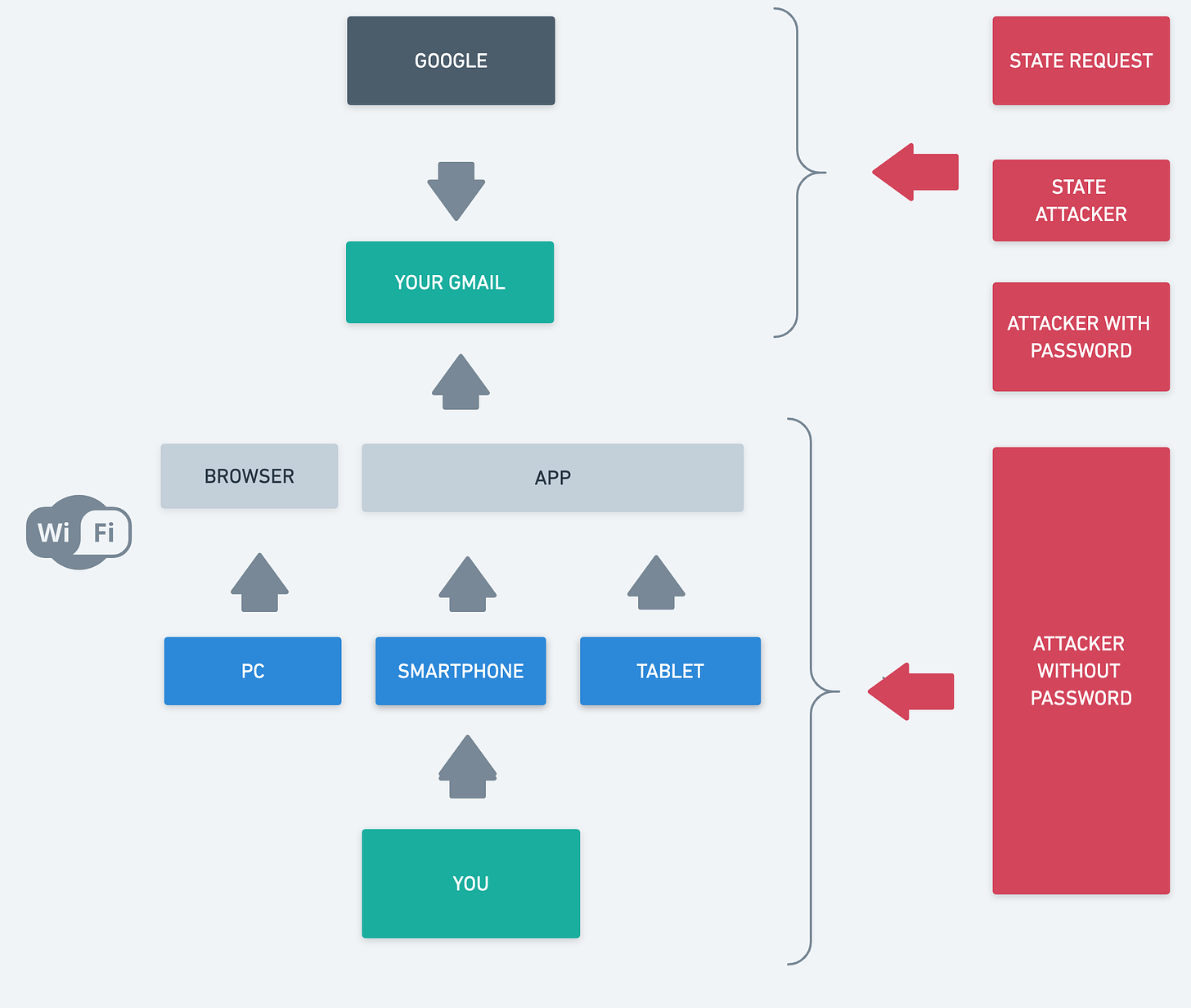

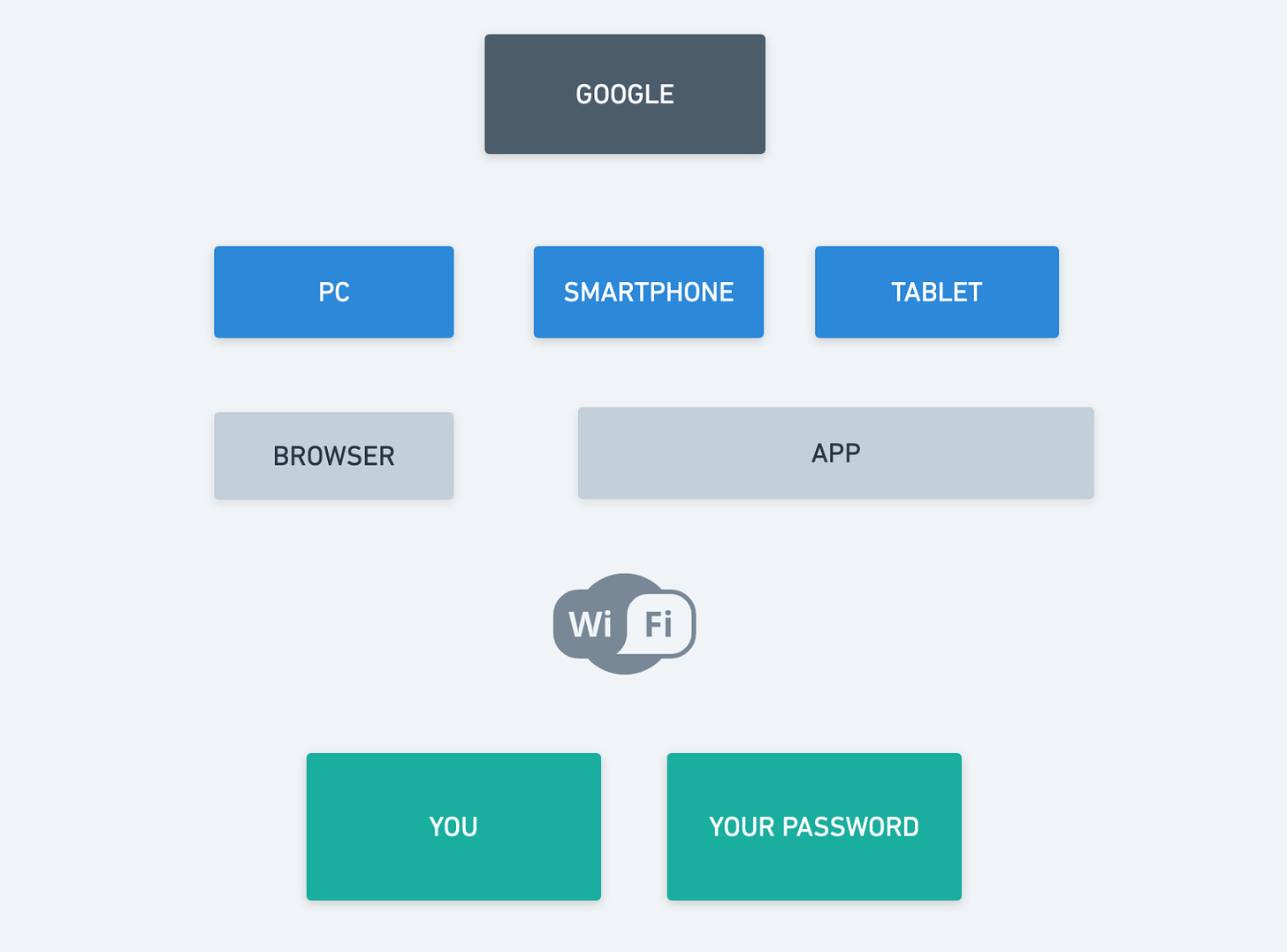

Dunque proviamo a fare un esercizio assieme. Partiamo dal grafico sottostante.

Potremmo considerarlo un frammento di una attività di threat modeling per una persona. Un frammento (semplificato qua al massimo) che parte da uno dei suoi asset più importanti, la mail (ho preso per comodità Gmail, vista la sua diffusione).

Nel grafico troverete che ogni freccia indica un percorso (o un pezzetto di percorso) per accedere alla vostra casella Gmail. Ovvero YOU (TU) detentore dell’account ci accedi di solito usando un pc, uno smartphone e un tablet (almeno nella nostra simulazione). Ognuno di questi usa a sua volta una app o un browser (e una connessione, ad esempio un punto d’accesso Wi-Fi). Che si connette a Gmail.

Ma anche Google può accedere a Gmail (che lo faccia o meno non importa, interessa la possibilità per ora).

E anche un attaccante che abbia le credenziali (semplificate qui con password).

E anche un attaccante che non abbia le nostre credenziali ma riesca a infilarsi nel nostro percorso per accedere a Gmail (ad esempio, usando uno dei nostri apparecchi o software. Anche qua il termine usare è volutamente vago: si va dall’infezione con un trojan veicolata navigando col browser su un sito malevolo a qualcuno che acceda fisicamente al nostro tablet incustodito). Ma l’attacco potrebbe anche essere direttamente contro di noi: qualcuno che ci prenda il telefono di mano fisicamente; o ci inganni con una operazione di social engineering per farsi consegnare la password; o ci minacci fisicamente per avere la password.

Ora il threat modeling sarà:

– fare una lista delle possibilità di attacco/vulnerabilità dato questo schema che contempla i modi in cui noi o altri accediamo al nostro Gmail;

– valutare quelli che per noi sono gli attacchi/vulnerabilità più probabili, scartare quelli improbabili o comunque quasi impossibili da rimediare, e su tutti gli altri applicare dei rimedi – in gergo si dice che applichiamo dei controlli, ovvero delle contromisure contro questi attacchi, e le contromisure possono essere tecniche (ad esempio, cifratura) o procedurali (non rivelo la password a uno al telefono che si finge MrBigGoogle, ogni riferimento a Carrie è puramente casuale).

Detto altrimenti (usando l’aiuto da casa di Andrew Lee-Thorp in questa presentazione video sul threat modeling):

- costruisci il modello, una rappresentazione del sistema

- poniti delle domande sul sistema (essenzialmente: cosa potrebbe andare storto?)

- identifica come mettere a posto i difetti trovati

Tutto chiaro? Iniziamo.

Ripartiamo dall’elenco di ciò che dobbiamo analizzare perché può portare, direttamente o indirettamente, al nostro Gmail. Agevolo grafico. Ognuna di queste caselle/riquadri colorati richiederebbe una analisi a se stante probabilmente. Inoltre ce ne potrebbero essere molte altre a seconda delle preferenze d’uso dell’utente (esempio: usa un servizio cloud per il backup delle mail? Usa un password manager? ecc ecc)

Ora immaginiamo solo alcune situazioni (non tutte ok?).

ATTACCANTE CON LA PASSWORD

Per la maggior parte di voi (di noi) l’attacco più probabile sarà quello dell’attaccante con password, cioè che è già in possesso della nostra password (vedi riquadro YOUR PASSWORD nel grafico). Quindi dovremo lavorare per evitare che questo accada. Normalmente un attaccante ha la nostra password perché:

1) gliela abbiamo detta noi (rivelandola a ex convivente, collega ecc, scrivendola su un post-it ecc)

2) è una password che può essere indovinata da un umano (è il nome del nostro gatto molto amato e instagrammato seguito dal nostro anno di nascita, appena celebrato con compleanno e torta su Facebook) o da un programma (che prova tutte le parole esistenti ecc)

3) è una password difficile da indovinare ma non è unica, la usiamo anche sul forum di vattelapesca, sul sito degli scacchi cui ci siamo appena iscritti trascinati dall’entusiasmo per una serie Netflix, sul sito di dating per cuori spezzati dal Covid. Se uno di questi viene “bucato” da qualcuno e non protegge adeguatamente la password, l’attaccante potrà provare a usarla sul nostro Gmail (la pratica esecrabile di usare la stessa password su più account si chiama password reuse, e vi assicuro che ci sono ancora più leak in circolo figli del password reuse che virologi in tv).

4) password unica e difficile ma poi nelle opzioni recupero password ho risposto alle domande di sicurezza che mi chiedono il nome dell’asilo che frequentavo mettendo davvero quello (ma come fate a ricordarvelo poi?), e un attaccante motivato ha scoperto la risposta giusta da inserire.

5) gli esempi possono essere sempre più complessi: se usiamo un password manager (uno strumento che ti fa salvare tutte le password in un posto solo) e sopra ci salviamo anche la nostra password di Gmail dobbiamo sapere che la sicurezza di Gmail dipenderà dalla sicurezza della password con cui entriamo nel password manager (che probabilmente dovremmo aggiungere da qualche parte nel grafico sopra, essendo un’ulteriore via di accesso al nostro Gmail).

(PS: il password manager, se usato bene, è uno dei principali strumenti per alzare le vostre difese (insieme all’autenticazione a due fattori). Ce ne sono di vari tipi (qua una lista con pro e contro – PC Mag). Inoltre una volta che si inizia a usarlo scoprirete che è estremamente comodo.)

Ok, ora che abbiamo visto sopra alcuni casi (i vari 1,2, 3, 4, 5) applichiamo subito per ognuno delle contromisure che potranno essere tecniche o procedurali (mentre in contemporanea valutiamo la priorità da dare alla varie minacce in base al nostro profilo):

1) decidiamo che non dobbiamo rivelare la password a nessuno, se lo abbiamo fatto la cambiamo (procedurale)

2) cambiamo la password facile mettendone una lunga e difficile, con mix di lettere, numeri e caratteri speciali (tecnico). PS: la password P@ssw0rd! non vale eh

3) facciamo in modo che la nostra password Gmail sia unica (procedurale)

4) non rispondiamo in modo veritiero a domande di sicurezza che possono essere indovinate/ricostruite da altri (procedurale)

5) sulla 5, ma in generale a rinforzo anche delle altre, aggiungiamo l’autenticazione a due fattori. Così anche se qualcuno avrà la nostra password dovrà avere anche un codice generato dal nostro telefono per accedere. Scegliamo dunque di usare una app per generare i codici del nostro secondo fattore. Riduciamo il rischio che qualcuno possa usare il nostro telefono con la app bloccandolo con un pin (con la cifratura).

Se invece immaginiamo per qualche motivo di dover usare solo l’autenticazione a due fattori via sms (e non tramite app), alla nostra analisi dovremo aggiungere una serie di rischi/attacchi connessi al ricevimento dell’sms: l’operatore telefonico (o un suo dipendente) potrebbe essere compromesso/ingannato e permettere un cambio di SIM – SIM swap – richiesto dagli attaccanti che così a quel punto riceverebbero loro l’sms; o l’sms potrebbe essere “intercettato” con attacchi SS7 che sfruttano una nota vulnerabilità del protocollo usato nelle reti telefoniche. (Sul rischio SIM swap, prevalente negli Stati Uniti e in altri Stati, e alcune possibilità per mitigarlo vedi questo articolo di Cybersecurity360).

ATTACCANTE SENZA PASSWORD

SCENARIO A

Lo scenario A è il più diffuso e probabile. È quello in cui l’attaccante cercherà di farsi dare la password da voi senza che ve ne accorgiate. Quindi sarete attaccati direttamente voi (vedi riquadro YOU nel grafico).

Il metodo più diffuso e probabile sarà social engineering, ovvero l’inganno:

1) mail di phishing (finta notifica sicurezza di Gmail che dice che dovete cambiare subito la password perdiana!)

2) sms/messaggio o telefonata di phishing (in gergo, smishing o vishing)

3) altri metodi creativi

La contromisura sarà procedurale:

– non clicco su link sospetti, non inserisco le mie credenziali se non sono sicura che sia Gmail, non vado a cambiare la password da un link nella mail, non mi fido di sconosciuti al telefono anche se assicurano di essere un helpdesk, non accetto caramelle ecc

E tecnica:

– uso autenticazione a due fattori (è vero che il social engineering può riuscire ad aggirarla, ma se ad esempio adotto una chiavetta hardware tipo Yubikey come metodo di autenticazione diventa molto più dura se non impossibile).

SCENARIO B

L’attaccante cercherà di farsi dare la password minacciandovi fisicamente o legalmente (vedi riquadro YOU).

Contromisura procedurale per la minaccia legale:

– un buon avvocato se siete in uno Stato di diritto

Se non siete in uno Stato di diritto, dovete accettare il rischio di dover consegnare la password. Potete minimizzarlo riducendo i dati sensibili presenti sulla vostra mail. O viaggiare (se lo Stato è estero) senza i vostri usuali dispositivi e/o metterci sopra un Gmail secondario. O altro ancora. Ma questa è una soluzione estrema, e se il vostro threat model è quello di comuni mortali probabilmente lo scarterete o comunque sarà in fondo alle vostre priorità.

SCENARIO C

L’attaccante cercherà di accedere direttamente al vostro Gmail passando fisicamente dai vostri apparecchi, ergo tenterà di mettere le mani sui vostri telefoni, tablet, computer (vedi riquadro PC, SMARTPHONE, TABLET).

Contromisura tecnica:

– cifratura disco su tutto

Contromisura procedurale:

– non lascio i miei apparecchi incustoditi, specie se accesi; faccio in modo di inserire il blocco se mi allontano per poco, spengo (per attivare cifratura) se mi allontano di più o se lo trasporto.

(Questo scenario sarà ovviamente in cima alla vostra lista se lavorate in aree condivise, e dovete spesso allontanarvi dal pc per vari motivi; se non vi fidate di chi ha accesso ai vostri spazi; se viaggiate per lavoro, ecc)

SCENARIO D

L’attaccante prova a ottenere le vostre credenziali o comunque a leggervi la posta entrando da remoto nei vostri dispositivi. Può farlo in vari modi:

1) con un link in una mail/messaggio che vi farà installare un trojan

2) con una finta app da scaricare che invece è malevola

3) con una vulnerabilità del vostro software

4) con un aggiornamento malevolo di un software autentico

5) dirottando la vostra navigazione su un sito malevolo senza che ve ne accorgiate

….e in altri modi che non sto ad elencare…

(vedi riquadro SMARTPHONE, TABLET, PC intesi come sistema operativo ma anche BROWSER, APP ecc)

Contromisure tecniche e procedurali:

1) installate un antivirus, non cliccate su link di cui non siete sicuri, aprite allegati all’interno di applicazioni/ambienti sicure

2) non scaricate app e software a caso

3) aggiornate sempre i software, non visitate siti sconosciuti, non col computer su cui volete proteggere dati sensibili

4) in questo caso l’attaccante ha compromesso la supply chain, è di alto livello, sperate di non rientrare in questo threat model e comunque di essere solo un target casuale

4) tendenzialmente, idem come sopra

(Tenete però presente che se il vostro threat model include qualcuno che voglia entrare con un malware nel vostro pc quasi SOLO per leggervi la posta – invece che per cifrare tutto con un ransomware e chiedervi un riscatto, o per entrare nell’internet banking, siete in una alarm zone, in cui dovrete prendere molte altre contromisure… Una parte di giornalisti può essere inclusa in questa categoria, così come alcuni avvocati, legali, consulenti, politici ecc ).

Prendiamo ora ad esempio solo il riquadro TABLET e invertiamo l’ordine del ragionamento.

Avete adottato tutte le contromisure di cui sopra, password forte, autenticazione a due fattori, sul telefono avete una passphrase, il computer è cifrato… ma cosa altro potrebbe andare storto considerato che volete difendere la casella mail? Magari dal tablet vi eravate loggati su Gmail per controllare un giorno la posta mentre eravate chissà dove e di fretta, poi ve ne eravate quasi dimenticati, e il vostro tablet (che usate solo per la didattica a distanza dei figli) non ha PIN di sorta. Un giorno vostro figlio se lo porta a scuola e poi lo dimentica su un muretto. Oppure lo lasciate voi per errore in un bar o su un treno. Se aveste fatto threat modeling, avreste invece considerato che il tablet era uno dei modi per accedere al vostro Gmail e avreste potuto decidere di blindarlo con un PIN o passphrase, o meglio ancora, visto che andava in giro in mano ad altri, di togliere del tutto Gmail dallo stesso.

Ancora, vediamo la casella GOOGLE, ovvero la possibilità di una RICHIESTA STATALE E/O di un ATTACCANTE STATALE.

La maggior parte delle persone probabilmente non avrà questa preoccupazione in cima alla sua lista (specifico che per richiesta e/o attacco statale intendo qualsiasi Stato, non solo il vostro; e che la prima può essere una ingiunzione o altra richiesta legale nell’ambito di una giurisdizione, mentre con attacco intendo un accesso illegale fatto a insaputa della stessa azienda, in genere da parte di una intelligence). Tuttavia se invece vi considerate a rischio dovrete trovare il modo di cifrare le vostre mail sensibili (ce ne sono diversi, qua un elenco di opzioni; e qua un altro). Vale anche per lo scenario in cui non vi fidiate di Google (ma allora fate prima a non usare proprio i suoi servizi).